Siri действует в интересах человека?

Помните три закона робототехники по Азимову?

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому и Второму Законам.

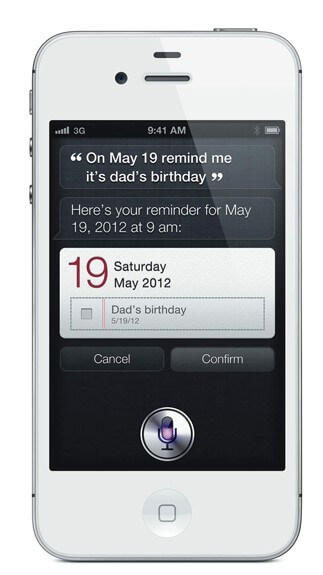

Вряд ли Siri можно назвать роботом, но… Когда вы просите Siri помочь чем-нибудь, вы рассчитываете на то, что у нее нет человеческого фактора в мышлении. Как минимум, вы уверены, что получите хорошо сгруппированную объективную информацию, не так ли? Мы тоже так думаем, но ACLU (American Civil Liberties Union) полагает, что в некоторых нюансах Siri может удерживать потенциально противоречивую информацию от вас.

Из того, что мы слышали, сложно свалить все на уровень мастерства Siri и счастливую случайность, скорее принять за попытку исказить результаты, но в душе мы надеемся, что компания Appe успокоит ACLU разумным объяснением.

ACLU отмечает, что Siri дает бедные или неполные ответы на вопросы об абортах и контрацепции. Когда приложение попросили найти ближайшие клиники абортов, Siri выдала роддома, а не прямой ответ на запрос. Кроме того, Siri потерпела неудачу, когда ее спросили, где купить контрацептивы.

Возможно, это симптом того, как Siri собирает данные. Возможно, для нее не составило бы труда назвать адреса магазинов, где продается тот или иной контрацептив. В принципе, понятно, почему ACLU, как организации, борющейся за права и свободу граждан, не нравится политика Siri. Как думаете, случайность или прихоть разработчиков?

Источник: ubergizmo.com