Apple подтвердила, что будет проверять наши фото. А ещё сообщения и поисковые запросы

Вчера многие СМИ раструбили новость о намерении Apple начать проверять фотографии пользователей прямо в их iPhone на предмет насилия над детьми. Естественно, это вызвало удивление, если не сказать негодование среди большинства пользователей. Ведь насколько бы негативно мы ни относились к издевательствам над детьми, всё-таки рыться в личных снимках – это такое попирание правил приватности, что большего, пожалуй, даже представить нельзя. Однако в Купертино и не собирались рыться в наших iPhone вручную, выстроив модель защиты детей несколько по иному принципу.

Apple и правда будет анализировать ваши фото. Правда, только из iCloud Photos

Зачем Apple будет копаться в ваших фото

В ночь с 5 на 6 августа Apple анонсировала три новых инициативы по обеспечению защиты малолетних пользователей iPhone, iPad и Mac. Они направлены на обнаружение материалов, содержащих признаки насилия над детьми и ограничение поисковых функций в отношении запрещённого контента. Эти механизмы начнут действовать позже в этом году после выхода iOS 15.

Как Apple проверяет наши фото

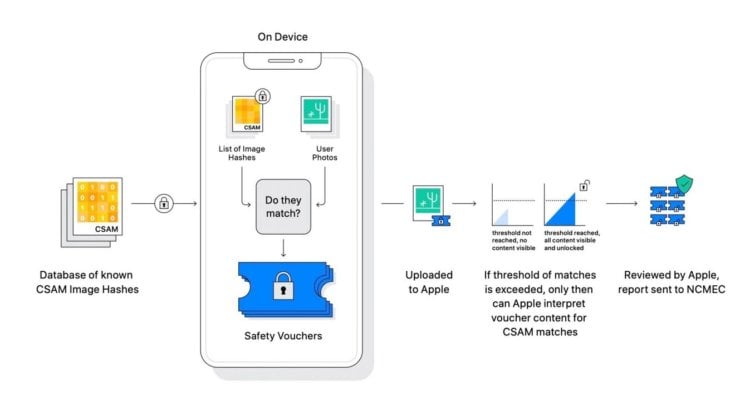

Первая инициатива, как и предполагалось, связана с фотографиями. Она предполагает изучение снимков из iCloud Photos на предмет признаков насилия над детьми. Компания разработала особую методику анализа, которая позволяет производить все вычисления прямо на устройстве, исключив человеческий фактор. То есть живые люди с фотографиями не взаимодействуют.

Анализироваться будут только те фото, которые выгружаются в облако. Но анализ будет производиться только на устройстве

Этим занимается специальный инструментарий, который основан на работе нейронных сетей и машинном обучении. Он отслеживает признаки, характерные для откровенных снимков с участием несовершеннолетних. Если Apple обнаружит фотографии с признаками насилия над детьми, она передаст эту информацию со всеми данными о владельце в компетентные органы.

Безопасность? Пфф. Уязвимость в iMessage позволила взломать iPhone десятков журналистов

С одной стороны, хорошо, что Apple исключила человеческий фактор из анализа фотографий. Так можно гарантировать, что никто из сотрудников компании не сможет увидеть ваши фотографии. Но, с другой, Apple всё равно будет рыться в наших смартфонах, пусть и несколько опосредованно. А это не самый лучший сценарий борьбы за конфиденциальность. Правда, на снимки, хранящиеся полностью локально это не распространяется.

Читает ли Apple наши сообщения

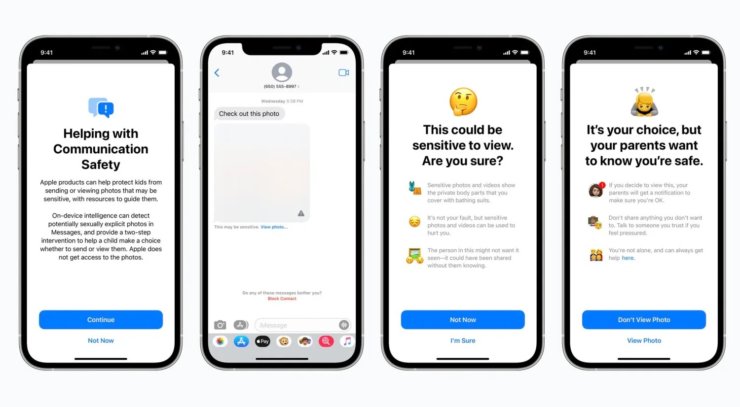

Похожий инструментарий Apple встроит и в приложение «Сообщения». Тут он будет играть роль своего рода брандмауэра, блокирующего доступ к нежелательному для детских глаз контенту. Суть этого нововведения состоит в том, что теперь, если ребёнок попробует отправить или получит снимок с откровенным содержанием, он увидит только размытое изображение и предупреждение.

Apple не будет читать сообщения малолетних пользователей, но даст такую возможность их родителям. Пусть и частичную

В этом предупреждении будет сказано, что изображение может носить чувствительный характер. Несмотря на это ребёнок сможет нажать на него, чтобы просмотреть, но увидит ещё одно предупреждение о том, что об этом действии узнают другие члены iCloud Family, с которыми связано его собственное устройство. Это правило будет действовать для детей младше 13 лет.

Apple плевать на вашу безопасность, или Почему в iOS 14 запретили слежку в приложениях

Apple объясняет, что «Сообщения» будут использовать те же нейросети и технологии машинного обучения, которые выявляют фотографии с насилием над детьми в iPhone пользователей. Они тоже будут действовать строго на устройстве, но только на первых порах брандмауэр заработает только для учётных записей iCloud, созданных в США. Другие страны подключат позднее.

Как Siri изменится в iOS 15

В iOS 15 будут расширены возможности Siri и функции поиска, которые позволят детям и их родителям чувствовать себя в безопасности при использовании интернета. Например, теперь пользователи смогут спросить голосового ассистента, куда пожаловаться на насилие над детьми или эксплуатацию труда несовершеннолетних, и Siri тут же подскажет эту информацию.

Siri не может ограничить поисковую выдачу, но она стремится к этому

Кроме того, Siri будет предупреждать о нежелательности контента с насилием или эксплуатацией несовершеннолетних детей. Если вы попросите голосового ассистента найти что-то такое в интернете, он предупредит о том, что эта информация может быть опасна. Поэтому вместо них Siri предложит ресурсы, где помогают людям, страдающим от влечения к подобным темам.

Конкуренты Apple пожаловались на слишком высокую безопасность iOS

Правда, ограничивать поисковую выдачу Siri не сможет. Дело в том, что она не может исключать из неё определённые ссылки и оставлять другие, которые ей кажутся приемлемыми. Так что здесь Apple явно пригодился бы её собственный поисковик, где она сама смогла бы решать, каким контентом можно делиться с пользователями разных возрастов, а каким – категорически нельзя.