Apple Watch скоро научатся распознавать новые жесты с помощью ИИ

Вы наверняка управляли смартфоном голосом или взглядом, но что, если гаджет на запястье сможет считывать ваши жесты буквально по мышечным импульсам? Умные часы Apple уже распознают некоторые жесты, но компания работает над следующим шагом. Звучит фантастически, но Apple опубликовала исследование, в котором ИИ-модель впервые распознаёт ранее невиданные жесты рук по сигналам мышц, снятым с носимых датчиков.

Apple научила ИИ распознавать новые жесты на ваших носимых устройствах

❗️ПОДПИСЫВАЙСЯ НА НАШ КАНАЛ В ДЗЕНЕ И ЧИТАЙ КРУТЫЕ СТАТЬИ БЕСПЛАТНО

Что такое электромиография и зачем она нужна в гаджетах

Apple опубликовала новое исследование в своём блоге Machine Learning Research. Работа называется EMBridge: Enhancing Gesture Generalization from EMG Signals through Cross-Modal Representation Learning и будет представлена на конференции ICLR 2026 в апреле.

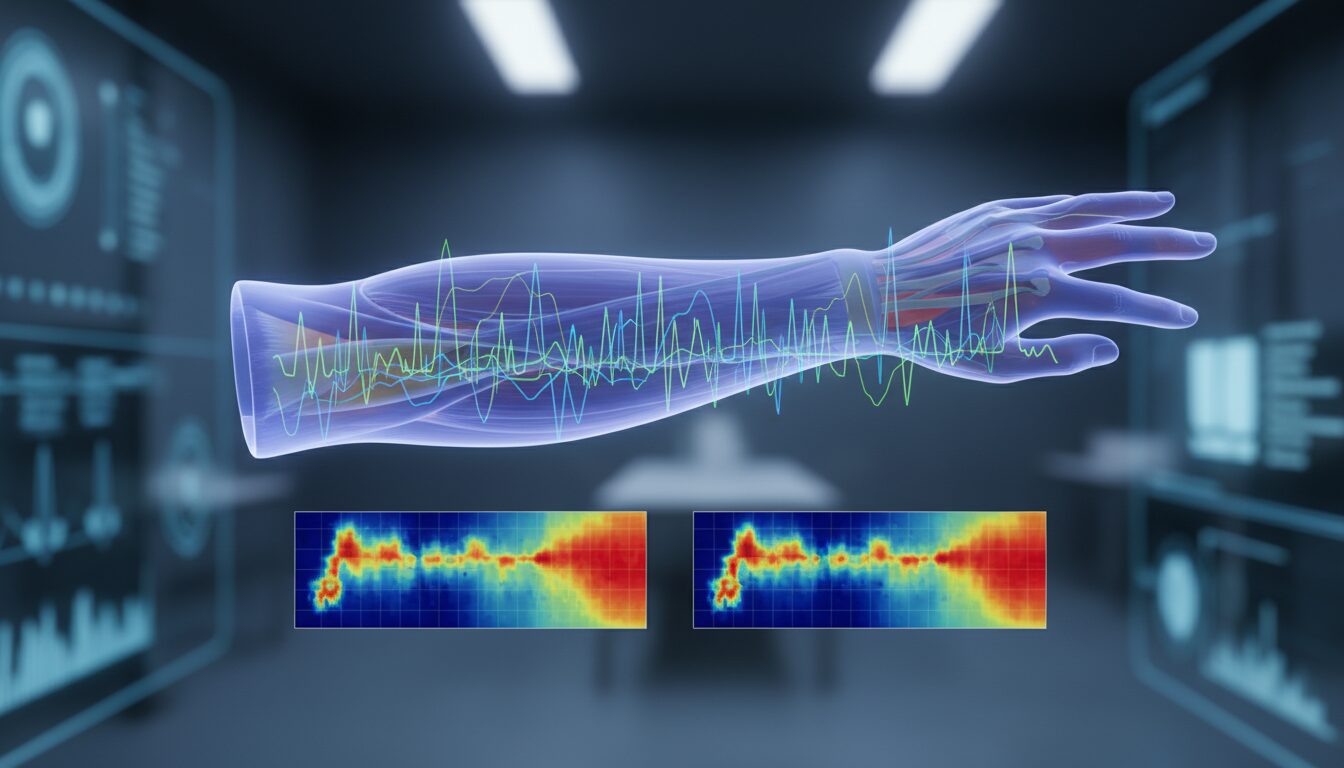

В центре исследования — технология EMG, или электромиография. Проще говоря, это метод измерения электрической активности мышц во время их сокращения. На практике EMG давно применяется в медицинской диагностике, физической терапии и управлении протезами конечностей.

Но в последнее время эту технологию всё активнее изучают в контексте носимых устройств и AR/VR-систем. Например, очки Meta* Ray-Ban Display используют EMG-технологию в виде так называемого Neural Band — браслета на запястье, который, по описанию Meta*, «интерпретирует ваши мышечные сигналы для навигации по функциям устройства».

Оказывается, Apple движется в похожем направлении. И, судя по исследованию, очень уверенно.

EMG-сигналы уже используются для управления протезами, а скоро могут управлять и вашими часами.

Какие данные Apple использовала для обучения модели

Что интересно, в исследовании Apple EMG-сигналы снимались не с наручного браслета, а с помощью двух крупных датасетов. Первый — emg2pose — масштабная открытая база, содержащая 370 часов записей EMG-сигналов с синхронизированными данными о положении рук. В ней участвовали 193 пользователя, выполнявших 29 различных групп движений — от сжатия кулака до счёта на пальцах. Общий объём меток положения рук превышает 80 миллионов, что сопоставимо с крупнейшими датасетами в компьютерном зрении.

Каждое движение пальца — это целая симфония электрических импульсов в мышцах предплечья

Второй датасет — NinaPro DB2 — включает парные данные EMG и положения рук от 40 испытуемых по 49 различным жестам: базовые сгибания пальцев, функциональные захваты и комбинированные движения. EMG-сигналы записывались с 12 электродов на предплечье с частотой дискретизации 2 кГц.

Для сравнения: 80 миллионов меток положения рук — это как если бы каждый житель Германии показал по жесту, и каждый был бы записан и размечен.

Как работает EMBridge и почему это прорыв

Apple давно использует ИИ не только в продуктах, но и в самом производстве — роботы на заводах Apple уже собирают iPhone с помощью нейросетей, и это только начало. А теперь главная разработка исследования — фреймворк EMBridge. Его задача — «навести мосты» между реальными мышечными сигналами и структурированными данными о положении рук.

❗️ПОДПИСЫВАЙСЯ НА ТЕЛЕГРАМ-КАНАЛ СУНДУК АЛИБАБЫ. ТАМ КАЖДЫЙ ДЕНЬ ВЫХОДЯТ ПОДБОРКИ САМЫХ ЛУЧШИХ ТОВАРОВ С АЛИЭКСПРЕСС

Модель сначала обучалась на EMG-данных и данных о позах рук по отдельности. Затем исследователи выровняли два типа представлений так, чтобы EMG-энкодер мог учиться у позового энкодера. Другими словами, модель научилась понимать жесты через призму мышечных сигналов.

Дальше команда применила так называемую маскированную реконструкцию позы: часть данных о положении руки скрывалась, и модель должна была восстановить их, используя исключительно информацию из EMG-сигналов. Это как если бы вас попросили угадать слово, закрыв половину букв, но вы при этом слышите, как его произносят.

Модель буквально учится «переводить» с языка мышц на язык жестов — даже если этот конкретный жест она видит впервые.

Чтобы снизить ошибки обучения, когда похожие жесты случайно воспринимались как совершенно разные, исследователи научили модель распознавать близкие конфигурации рук и генерировать для них «мягкие метки», а не жёсткие категории. Это значительно улучшило способность системы обобщать жесты.

Результат впечатляет. По словам авторов: «EMBridge — первый фреймворк кросс-модального обучения представлений, способный к zero-shot классификации жестов по EMG-сигналам с носимых устройств». Проще говоря, модель умеет распознавать жесты, которые вообще не были частью её обучающего набора данных. И делает это, используя лишь 40% тренировочных данных по сравнению с существующими методами.

Зачем это нужно Apple и что это значит для пользователей

Само исследование, разумеется, не упоминает конкретные будущие продукты Apple. Но авторы прямо указывают на практическое применение: носимые устройства для взаимодействия человека с компьютером. В тексте работы говорится о сценариях VR/AR и управления протезами, где «устройство на запястье должно непрерывно определять жесты рук по EMG, чтобы управлять виртуальным аватаром или роботизированной рукой».

❗️ПОДПИСЫВАЙСЯ НА КАНАЛ AppleInsider.ru В МЕССЕНДЖЕРЕ MAX. ТАМ КУДА БОЛЬШЕ КОНТЕНТА, ЧЕМ НА САЙТЕ, И РАБОТАЕТ ОН ДАЖЕ НА СТОЯНКАХ

Нетрудно представить, как такая технология может быть реализована в будущих моделях Apple Watch или других носимых устройствах для управления Apple Vision Pro, Mac, iPhone и даже умными очками, о разработке которых ходят слухи. Например, умные часы Apple уже сейчас измеряют параметры тела, и точность этих данных постоянно растёт.

На практике это открывает путь не только к новым способам взаимодействия с устройствами, но и к серьёзным улучшениям в сфере доступности. Для людей с ограниченными возможностями это особенно важно — функции универсального доступа на iPhone уже сейчас умеют то, о чём многие не догадываются, а EMG-управление могло бы стать следующим шагом.

Впрочем, есть и ограничение. Авторы отмечают, что модель пока зависит от специализированных датасетов, содержащих одновременно EMG-сигналы и синхронизированные данные о положении рук. Собирать такие данные непросто и дорого.

Возможно, совсем скоро для управления компьютером достаточно будет просто пошевелить пальцами.

❗️Читайте также: Apple обучает роботов вести себя как люди — с помощью видео и гарнитуры Vision Pro

Исследование EMBridge — ещё одно подтверждение того, что Apple серьёзно вкладывается в технологии, которые могут изменить саму суть взаимодействия человека с техникой. Жесты, которые модель никогда не видела, она уже распознаёт. А значит, будущее, где ваши часы понимают язык ваших мышц, ближе, чем кажется.

*запрещённая организация на территории Российской Федерации