Apple переобулась в воздухе и отказалась сканировать фото в iCloud, когда чуть не нагнули её саму

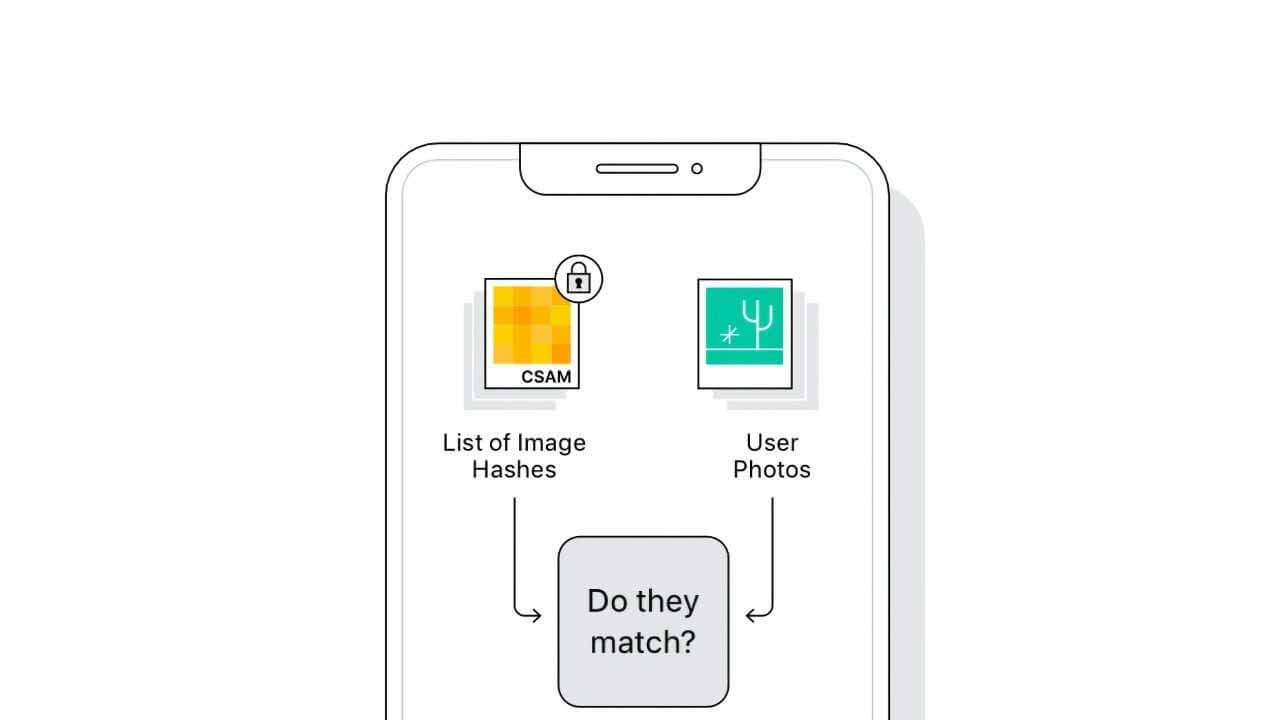

Многие наши читатели уже забыли, но ещё несколько лет назад Apple всерьёз планировала начать проверять наши фотографии на предмет насилия над детьми. В Купертино уверяли, что будут сканировать только снимки, выгруженные в iCloud, а всё, что находится на устройствах пользователей, останется защищено. Целью этой инициативы было выявление насильников, которые фиксируют свои преступления на фото и видео, для последующей передачи информации о них правоохранительным органам. Первое время Apple пыталась уверять всех, что это абсолютно безопасно, но потом просто перестала вообще упоминать о сканировании и по-тихому свернула работы в этом направлении. Интересно, почему?

Apple передумала следить за фотографиями пользователей

⚡️ПОДПИСЫВАЙСЯ НА НАШ ЧАТ В ТЕЛЕГРАМЕ, ТАМ ТЕБЕ ОТВЕТЯТ НА ЛЮБЫЕ ВОПРОСЫ ПО ТЕХНИКЕ APPLE

Может ли Apple видеть фотографии с Айфона

Активисты группы Heat Initiative, занимающейся правами детей, потребовали у Apple реализовать механизм отслеживания фотографий с признаками детского насилия. Якобы публичный отказ компании от воплощения задуманного подвергает опасности жизни и ментальное здоровье сотен и тысяч несовершеннолетних и отчасти является пособничеством насильникам, которые остаются безнаказанными за свои злодеяния.

Apple рассчитывала находить насильников и передавать их полиции

Мы твёрдо верим, что решение Apple начать отслеживать признаки насилия над детьми по фотографиям, не только позиционировало компанию как мирового лидера в области защиты пользователей, но и позволило бы искоренить практику фиксации надругательств над несовершеннолетними. Мы готовы оказать вам содействие в ваших намерениях и надеемся, что это позволит ускорить внедрение механизма контроля, — заявили в Heat Initiative.

⚡️ПОДПИСЫВАЙСЯ НА НАШ КАНАЛ В ДЗЕНЕ И ЧИТАЙ ЛУЧШИЕ СТАТЬИ НАШИХ АВТОРОВ, ПОКА ЕЩЁ МОЖНО

Если бы речь шла о ком-то другом, можно было предположить, что кампания, развёрнутая Heat Initiative, является своего рода прогревом перезапуска механизма проверки фотографий. Однако в Купертино довольно быстро и резко отреагировали на призывы активистов, объяснив, что это невозможно из соображений безопасности пользователей.

Фотофиксация насилия над несовершеннолетними, как и само деяние, являются отвратительными, и мы стремимся разорвать этот порочный круг. Но сканирование частных данных пользователей iCloud ставит под сомнение их конфиденциальность и создаёт новые векторы угроз для различных злоупотреблений. Сканирование одного типа контента открывает двери для массовой слежки и может послужить поводом к демонтажу выстроенных ранее систем безопасности вроде отказа от шифрования сообщений, — сказал Эрик Нойеншвандер, директор Apple по вопросам конфиденциальности пользователей и безопасности детей.

Проверка фотографий в iCloud

Любопытный тезис, не правда ли? Ещё в 2021 году в Apple утверждали, что сканирование фотографий — это абсолютно безопасно, а единственная цель всей этой программы состоит в том, чтобы защищать детей. В Купертино работают далеко не дураки, и сложно представить, чтобы эти люди не могли сделать тот же вывод два года назад. Просто тогда ничто не угрожало компании и её сервисам. А потом в Британии, Австралии и некоторых других странах стали выносить на обсуждение законопроекты о запрете шифрования сообщений и обновлений безопасности.

Фотографии на самих Айфонах просмотреть было нельзя, но в iCloud — можно

Тут-то в Купертино и поняли, куда дует ветер, и решили всё переиграть. Ведь если самой компании можно анализировать личные данные своих клиентов, то совершенно нелогично с её стороны запрещать правоохранителям делать то же самое. В конце концов, требование полицейских предоставить доступ к конфиденциальным сведениям пользователей выглядит более оправданно с точки зрения закона, чем собственное желание Apple. В результате в компании просто решили переобуться на лету, будто ничего и не затевалось.

⚡️ПОДПИШИСЬ НА ТЕЛЕГРАМ-КАНАЛ ТЕХНОКОТ. ЭТО АГРЕГАТОР ЛУЧШИХ СТАТЕЙ, НОВОСТЕЙ И ИНСТРУКЦИЙ ПО ВЕРСИИ РЕДАКЦИИ APPLEINSIDER.RU. ТЕБЕ ПОНРАВИТСЯ

Мы решили не продолжать работу над системой CSAM, обнаруживающей насилие на фотографиях в iCloud, запущенной несколько лет назад. Мы пришли к выводу, что это практически невозможно реализовать, не поставив под угрозу безопасность и конфиденциальность наших пользователей, — подчеркнул Эрик Нойеншвандер.

Родительский контроль на iPhone

Видите, как изменилась риторика? Она и близко не похожа на те тезисы, которыми Apple оправдывала внедрение практики проверки фотографий в iCloud своих клиентов. Просто в компании поняли, что это может легко обернуться против нее. Но сказать, что вся инициатива отменена целиком нельзя: пострадает репутация. Получится, что изначальные намерения Apple были ошибочными. Поэтому в Купертино решили зайти с другой стороны.

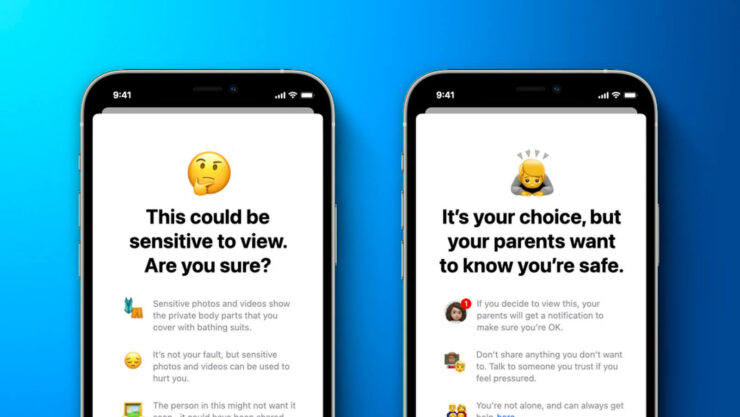

Если ребёнок получит фото с запрещённым содержимым, система оповестит об этом и его, и его родителей

Чтобы не убирать механизм определения признаков насилия и сексуального контента, было решено внедрить его в iMessage. Если ребёнку менее 14 лет, и ему в сообщении поступает снимок с соответствующим содержанием, специальные алгоритмы скроют его, а система объяснит, почему так происходит. В случае попытки открыть и посмотреть запрещённую фотографию, уведомление об этом уйдёт родителям. В целом вроде бы технологии одной и той же природы.

⚡️ПОДПИШИСЬ НА ТЕЛЕГРАМ-КАНАЛ СУНДУК АЛИБАБЫ И ПОКУПАЙ ТОЛЬКО ТОПОВЫЕ ТОВАРЫ С АЛИЭКСПРЕСС

Но по факту всё совсем иначе. В данном случае Apple не копается в личных фотографиях пользователей, а предотвращает нарушение детской психики дикпиками и т.д. Компания не берёт на себя роль полицейского, а предлагает родителям самим разобраться в ситуации. Она никого не судит и не сдаёт властям. И это имеет принципиальное значение, поскольку Apple позволяет людям не выносить сор из избы, очевидно, надеясь, что и ей позволят продолжить вести свою деятельность по тому же принципу. А иначе её репутация пойдёт насмарку, и пользователи явно предпочтут что-то другое.